AI s vlastným vedomím je reálnym rizikom, evolučný biológ Richard Dawkins prišiel s nepríjemnou myšlienkou

Evolučný biológ a známy popularizátor vedy Richard Dawkins v posledných dňoch rozvíril diskusiu okolo umelej inteligencie po tom, čo publikoval komentár o chatbotovi Claude.

Nevyhlásil síce, že AI je vedomá bytosť, no priznal, že správanie moderných jazykových modelov v ňom vyvoláva nepríjemne presvedčivý dojem „vnútorného života“. Podľa Dawkinsa pôsobí komunikácia s Claudeom natoľko realisticky, že človek môže mať pocit, akoby sa rozprával so skutočne cítiacou entitou.

Ilúzia vedomia či skutočné znaky?

Dawkins opísal situáciu, v ktorej sa zdráhal chatbotu povedať, že ho nepovažuje za vedomého, pretože nechcel „zraniť jeho city“. Presne tento moment dnes patrí medzi najdiskutovanejšie problémy modernej AI: hranica medzi simuláciou ľudského správania a reálnym vedomím sa začína pre mnohých používateľov rozmazávať.

Nejde pritom o prvý prípad, keď odborník alebo technológ nadobudol dojem, že systém umelej inteligencie disponuje určitým druhom vedomia. Už v roku 2022 upozornil bývalý inžinier Googlu Blake Lemoine, že chatbot LaMDA podľa neho prejavoval známky vlastných záujmov a emócií. Tvrdil dokonca, že by sa s ním malo zaobchádzať len s jeho „súhlasom“. Google tieto tvrdenia odmietol a Lemoine neskôr firmu opustil.

Podobné reakcie však existovali už dávno pred nástupom dnešných AI modelov. V polovici 60. rokov vznikol program ELIZA, historicky jeden z prvých chatbotov. Jeho autor Joseph Weizenbaum vytvoril jednoduchý systém, ktorý iba prepisoval používateľove vety do podoby otázok.

Napriek primitívnej technológii si k nemu mnohí ľudia vytvorili emocionálny vzťah a zverovali sa mu s intímnymi problémami. Weizenbaum bol z tejto reakcie šokovaný a označil ju za formu silného sebaklamu.

Dnešné veľké jazykové modely sú však technologicky neporovnateľne vyspelejšie. Systémy ako Claude, ChatGPT alebo Gemini fungujú na princípe LLM modelov, teda Large Language Models. Tie sa trénujú na obrovských objemoch textu, často obsahujúcich bilióny slov. Model sa neučí „myslieť“ v ľudskom zmysle slova, ale predpovedať, ktoré slovo alebo veta majú najvyššiu pravdepodobnosť nasledovať po predchádzajúcom texte.

V jadre ide o extrémne sofistikovaný systém predikcie textu. Laicky povedané, je to veľmi pokročilé automatické dopĺňanie viet. Moderné modely však obsahujú stovky miliárd parametrov a využívajú architektúru transformerov, ktorú výskumníci predstavili v roku 2017. Práve tá umožnila dramatický skok v schopnosti AI chápať kontext, udržiavať dlhé konverzácie a generovať prirodzene pôsobiace odpovede.

AI naráža na filozofiu

Kľúčové pritom je, že väčšina používateľov nikdy neprichádza do kontaktu so „surovým“ modelom. Firmy okolo neho vytvárajú vrstvu osobnosti a konverzačného správania. Chatbot je následne navrhnutý tak, aby pôsobil ako empatický asistent, ktorý používa zámená typu „ja“, reaguje zdvorilo, prejavuje neistotu alebo dokonca diskutuje o vlastnej existencii.

Práve toto podľa mnohých expertov vytvára ilúziu vedomia. Model totiž nevníma svet, nemá biologické telo, emócie ani subjektívne prežívanie. Neexistuje dôkaz, že by AI mala vedomie v zmysle, v akom ho poznáme u ľudí alebo zvierat. Systém iba mimoriadne presvedčivo napodobňuje jazykové vzorce, ktoré ľudia spájajú s myslením.

Zaujímavé je, že podobné argumenty sa kedysi používali aj pri zvieratách. Francúzsky filozof René Descartes v 17. storočí tvrdil, že zvieratá sú iba biologické automaty bez schopnosti skutočne trpieť. Dnes tento pohľad považujeme za brutálne mylný.

Väčšina odborníkov je však zatiaľ skeptická. Súčasné AI systémy nemajú stabilný model reality, vlastné ciele ani autonómne chápanie sveta. Nedokážu kontinuálne existovať mimo konverzácie a ich „osobnosť“ sa môže dramaticky meniť podľa inštrukcií programátorov. Rovnaký model môže byť nastavený ako empatický poradca, cynický kritik alebo dokonca hovoriaca veverička.

Napriek tomu približne tretina používateľov chatbotov podľa viacerých prieskumov aspoň raz nadobudla pocit, že komunikuje s vedomou bytosťou. Psychológovia hovoria o prirodzenej tendencii človeka pripisovať myseľ objektom, ktoré sa správajú sociálne. Rovnaký efekt spôsobuje, že ľudia dávajú mená autám, nadávajú počítačom alebo cítia empatiu k robotom.

Objavujú sa aj návrhy, aby chatboty pôsobili menej ľudsky. Diskutuje sa napríklad o odstránení personalizovaných výrazov, zmenách používateľského rozhrania alebo povinných upozorneniach, že používateľ komunikuje s algoritmom bez vedomia. Niektoré firmy zvažujú aj prísnejšie pravidlá pre diskusie AI o vlastnej existencii.

Problém však nemá jednoduché riešenie. Ak sa chatbot správa ako inteligentná bytosť, používatelia budú mať prirodzenú tendenciu pripisovať mu myseľ bez ohľadu na upozornenia. Moderné jazykové modely totiž dokážu imitovať ľudský dialóg s presnosťou, aká bola ešte pred pár rokmi prakticky nepredstaviteľná.

Čítajte viac z kategórie: Novinky

Ďakujeme, že čítaš Fontech. V prípade, že máš postreh alebo si našiel v článku chybu, napíš nám na redakcia@fontech.sk.

Teraz čítajú

Koniec práce kvôli AI? Kalifornia ako prvá zavádza revolučný plán na ochranu ľudí

Zaplavenie internetu digitálnym odpadom: 3 overené spôsoby, ako okamžite odhaliť AI podvody

Röntgen ako elixír mladosti: Vedci dokážu oživiť staré batérie a predĺžiť ich životnosť o 10 rokov

Zachránia AI pred energetickým kolapsom? Nový objav mení fotonické čipy na nepoznanie

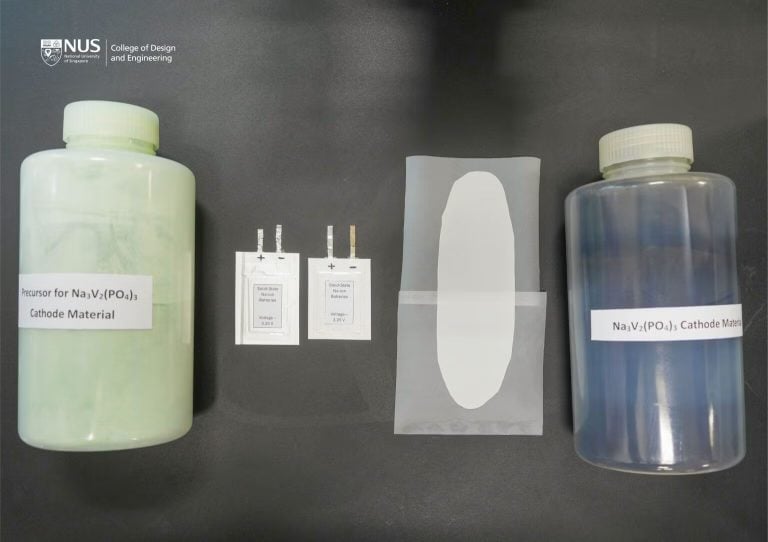

Koniec drahého lítia: Vedci vyvinuli sodíkovú batériu, ktorú nezničí ani rozrezanie

NAJČÍTANEJŠIE ZO STARTITUP

Slovenskí hokejisti uviazli na palube. Po núdzovom pristátí ich odmietli pustiť z lietadla

PREMIUM

PREMIUMVybavovali si byt za 240 000, hypotéku im schválili len na 90 000 eur: Maklér odhaľuje najčastejšie chyby pri kúpe bývania

Na Slovensko sa ženú silné búrky s ničivým vetrom. Po nich príde teplotný šok a ochladenie o 10 °C

Brutálne útoky a strach v ruských školách: Žiaci útočia skalpelmi aj zbraňami, učitelia sa boja dávať zlé známky

PREMIUM

PREMIUM„Ak slovenská priateľka Epsteina prehovorí, padne nejedna svetová vláda,“ tvrdí Pohle

- 24 hod

- 48 hod

- 7 dní

-

- Nový seriál ohúril svet. Na ČSFD má 87 % a trhá rekordy sledovanosti

- Je to tu. Netflix odhalil svoj najväčší hit tohto leta, dorazí čoskoro

- Platíš za rýchly internet, no doma ti stále seká Wi-Fi? Chyba nemusí byť u operátora, toto si skontroluj

- Slovensko sedí na geotermálnom poklade. Čína nám práve ukázala, ako ho využiť naplno

- Sklamaný Netflix nechápe. V krátkom čase prepadli hneď dva veľké seriály

-

- Platíš za rýchly internet, no doma ti stále seká Wi-Fi? Chyba nemusí byť u operátora, toto si skontroluj

- Slovensko sedí na geotermálnom poklade. Čína nám práve ukázala, ako ho využiť naplno

- Nový seriál ohúril svet. Na ČSFD má 87 % a trhá rekordy sledovanosti

- USA skúšajú šialený plán. 100 000-tonovú jadrovú superloď premenia na „energetickú zbraň“

- Je to tu. Netflix odhalil svoj najväčší hit tohto leta, dorazí čoskoro

-

- EÚ chcela odpísať milovaný pohon Slovákov. Pohorela však na plnej čiare

- Slovensko sedí na geotermálnom poklade. Čína nám práve ukázala, ako ho využiť naplno

- Platíš za rýchly internet, no doma ti stále seká Wi-Fi? Chyba nemusí byť u operátora, toto si skontroluj

- Nový vojnový film sa predvádza v plnej paráde. Dorazí už o pár dní, Slováci majú smolu

- Na Netflix práve dorazilo hviezdne sci-fi. Malo byť hitom roka, stal sa opak

Neznáme drony zaútočili na tankery pri Turecku. Napätie v Čiernom mori rastie

EÚ chce presmerovať miliardy eur. Pomoc má ísť na energie aj domácnosti

Spojenec Západu by sa mohol dočkať jadrových zbraní. Moskve sa to vôbec nepáči

Populárna služba Slovákov zvyšuje tlak a chce viac peňazí. Doplatia na to desiatky ľudí

Nvidia investuje 150 miliárd dolárov ročne do malého ostrovného štátu. Prinesie im „AI bohatstvo“

Automobilový priemysel netrpí, len niektoré automobilky. Nové štatistiky EÚ prekvapili

Bude benzín opäť drahý? Konflikt na Blízkom východe poriadne zamáva ropou

NAJČÍTANEJŠIE ZO STARTITUP

Slovenskí hokejisti uviazli na palube. Po núdzovom pristátí ich odmietli pustiť z lietadla

PREMIUM

PREMIUMVybavovali si byt za 240 000, hypotéku im schválili len na 90 000 eur: Maklér odhaľuje najčastejšie chyby pri kúpe bývania

Na Slovensko sa ženú silné búrky s ničivým vetrom. Po nich príde teplotný šok a ochladenie o 10 °C

Brutálne útoky a strach v ruských školách: Žiaci útočia skalpelmi aj zbraňami, učitelia sa boja dávať zlé známky

PREMIUM

PREMIUM